NVM-ExpressとIBM i に関する詳細情報

数週間前の記事で、IBMがPowerハードウェアに導入し、特にIBM i 7.4リリースのテクノロジー・リフレッシュ1(TR1)で利用可能となる新たなNVM-Expressフラッシュ カードについて触れました(10月のPower Systemsについてのアナウンスメントの中で目立たなかったかもしれませんが)。その時点では、容量や価格などのほかは、新たなドライブについての詳しい情報はあまりありませんでしたが、この記事では、その後分かったことも含めて、現時点で分かっている情報についてお知らせしようと思います。

NVM-Expressフラッシュの追加が、IBM i プラットフォームのようなデータベース セントリックなシステムにとって何を意味するのか(あるいは意味しないのか)という点については、今後、改めてIBMに詳しく話を聞く予定です。

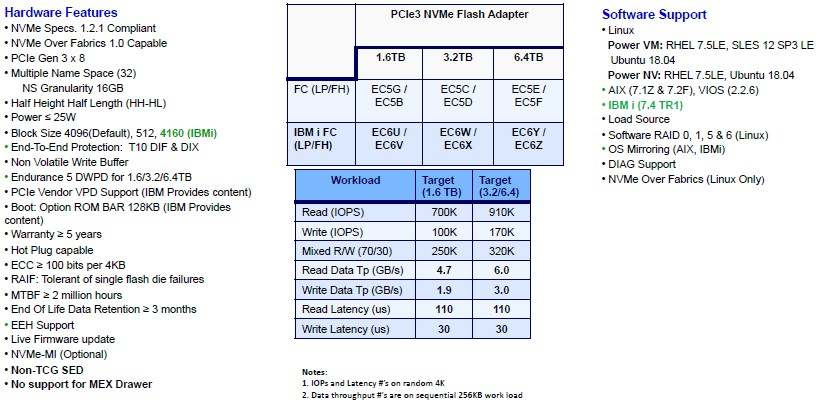

簡潔にまとめて言えば、 発表レター119-059(日本語版はJG19-0078)でIBMは、11コアPower9プロセッサー フィーチャーといくつかの新たなディスク ドライブに加えて、6つのNVM-Expressフラッシュ アダプター カードを発表したということです。これらは、SSDスロットではなく、サーバーのPCI Express 3.0 x8スロットへ接続するユニットです。一部のサーバーには、SSDスタイルのスロットを使用するNVM-Expressポートがありますが、これらはそれとは別物です。ご存じでない方向けに説明すれば、NVM-Expressは、フラッシュがオンボード コントローラーでどのようにアドレス指定されるかを認識するフラッシュ専用プロトコルで、ディスク ドライブのようなブロック デバイスであるかのように振る舞うことはありません。NVM-Expressは、ネイティブなフラッシュ メモリー アドレッシングであるため、SATAまたはSASフラッシュSSDに比べて、低遅延および高スループットを実現できます。これらの新たなPCI Expressフラッシュ カードは、以下に示すように、Power9システムでのみ利用可能です。- IBM i プラットフォーム向け1.6 TB NVM-Expressフラッシュ カードは、フィーチャー#EC6VがPower S914、Power S924、およびPower H924サーバー用、フィーチャー#EC6UがPower E980用です。

- ローエンド マシン用のフィーチャー#EC6X、およびPower E980用のフィーチャー#EC6Wは、IBM i プラットフォーム向けで容量は3.2 TBと倍になります。

- ローエンド マシン用のフィーチャー#EC6Z、およびPower E980用のフィーチャー#EC6Yは、IBM i プラットフォーム向けで容量は6.4 TBとさらに倍になります。

以前の記事で指摘した通り、3.2 TBおよび6.4 TBフラッシュ アダプター カードは、4コア以下のPower S914システムでは使用できません。1.6 TBフラッシュ カードのみ使用可能です。

以下に、IBM i オファリング マネージャーのAlison Butterill氏が提供してくれた、これらのフラッシュ ドライブに関する詳細情報を示します。Power9マシンへのNVM-Expressフラッシュの追加を検討する際には、以下の点について考慮する必要があります。

- NVM-Expressは独自の名前空間の定義を使用します。このケースでは、名前空間は、0 ~ (名前空間のサイズ - 1)の範囲の論理ブロック アドレスを有する論理ブロックの集まりです。名前空間ID(NSID)は、コントローラーによって使用される、名前空間へアクセスできるようにする識別子です。

- NVM-Expressは、SSDに比べてより高いパフォーマンスを実現できます(上述)。

- NVM-Expressは、Power9マシンで追加的な仮想化機能を提供します。すべてのデバイスは、LPAR専用にすることができるPCI-Expressエンドポイントになります。

- NVM-Expressデバイスは、初期設定ではペア構成となりますが、高度な設定を行うことにより、奇数個のNVM-Expressデバイスの使用も可能になります。

- P05プラットフォームでは、2つの1.6 TBデバイスまでに制限されています(これについても上述)。

- 仮想化NVM-Expressは、IBM i ではVirtual I/O Server(VIOS)を通じてサポートされます。

- NVM-Expressデバイスは、Db2 Mirrorでサポートされる直接接続デバイスに含まれています。

IBMのNVM-Expressフラッシュ アダプター カードのサプライヤーがどこなのかは明らかでありませんが、推測するところでは、Intelではなく、おそらく、SamsungかMicron Technology(あるいはその2社の組み合わせ)と思われ、IBMは複数のサプライヤーを持つということになります。以下の性能仕様を見たところでは、いくつかの点で異なっているため、1.6 TBアダプターはある1つのサプライヤーから、3.2 TBおよび6.4 TBアダプターは別のサプライヤーから、ということもあるかもしれません。

IOPS(入出力操作毎秒)は、ランダム読み取りおよびランダム書き込みの両方で、こうしたデバイスとしては非常に優れており、SATAまたはSASコントローラーを通じて接続されているSSDで得られるIOPSに比べて何倍も高速です。SSDは、ディスク ドライブを疑似することでオーバーヘッドをすべて抱えるからです。また、データ スループットもはるかに高く、このことは、多くのアプリケーションにとって重要なことです。ついでに言えば、これらの新たなNVM-Expressアダプターは、ロード ソース ストレージとして使用することもできます。Linuxシステムには、ストレージ デバイスのデータを保護するために使用される、ソフトウェア ベースのRAID機能(RAID 0、1、5および6レベル)が備わっています。私の知る限り、Linuxには、10年以上前からソフトウェア ベースのミラーリングがありました。オーバーヘッドはかなり大きかったものの、異常なほどではありませんでした。言うまでもありませんが、2台のデバイスだけの場合は、RAID 0のストライピング(2台を1台の論理ストレージ デバイスのように扱う)、またはRAID 1のミラーリング(2台のデバイスで同じストレージのコピーを保持する)のいずれかに限られます。RAID 5では、私の知る限り、4台以上のデバイスが必要です(データストライピング用に3台、RAID 5アルゴリズムからのパリティ データ用に1台ですが、私は通常、4台のデバイスにプラスしてパリティ用に1台としています)。RAID 6では、ホット スペア付きでRAID 5を行い、合計5台または6台のデバイスで、障害が発生した場合に自動的に1台のデバイスをリストアします。

IBMは、RAIDグループを作成できるように、6台のNVM-Expressフラッシュ ドライブを売りたいようですが、思い出してください、これらは、RAIDアルゴリズムが組み込まれたストレージ コントローラーにぶら下がっているのではありませんし、また、AIXとIBM i のどちらにも、ディスクまたはフラッシュ ストレージのソフトウェア ベースのミラーリングはありません。確かに、追加することはできますが、現時点のIBMの姿勢としては、フラッシュ アダプター カードに保存されるデータを保護するには、ハイ アベイラビリティー システム ミラーリング ソフトウェア(上の図で「OS Mirroring」とされているもの)を使用するということのようです。誰もフラッシュ アダプターがぎっしり詰まった2台のマシンを購入したくはありませんが、Microsoft、Skytap、IBM、またはGoogleパブリック クラウドのPower S922へバックアップすることで事足りるのです。IBMがここで顧客に提供しているように、それらが高速なフラッシュ デバイスを備えているのであれば、特にそうです。

最後に1つ、言っておくことがあります。私たちは、NVM-Express over Fabrics接続(数多くの別個のマシンに分散したストレージが、クラスターのすべてのサーバーにはローカルに見えるようにすることができる)をとても楽しみに思っていますが、利用可能なのは、Linuxを稼動しているPower9マシンでのみです。いつの日か、PowerベースのSANのDSシリーズの売り上げの落ち込みを目にするのにうんざりするときが来たら、IBMは、NVMe-oFプロトコルを使用してPower-Linuxハードウェアをベースにストレージ クラスターを作成し、フラッシュは完全にサーバーから切り離され、最新のSANのように使用されるようになることでしょう。それこそが、多くのスタートアップが行っていることであり、また、ハイパースケーラーやクラウド ビルダーが行うやり方でもあります。フラッシュを特定のサーバーに縛り付けておく理由はありませんが、どのような形であれ、NVM-Expressフラッシュを提供したことは、まったくなかったことからすれば、改善と言えるでしょう。